En mai 2024, un ingénieur a commis une erreur. Une documentation interne de Google — 14 014 attributs répartis dans 2 596 modules — s’est retrouvée publiquement accessible sur un dépôt de code pendant plusieurs jours. Les experts SEO du monde entier se sont jetés dessus. Ce qu’ils ont découvert contredisait frontalement les déclarations officielles de Google depuis des années. Il existe bien un score de siteAuthority. Google utilise bien les clics comme signal de classement. Il existe bien un « sandbox » pour les nouveaux domaines. Autant d’affirmations que les porte-paroles de Google avaient niées, parfois avec condescendance, devant des milliers de professionnels.

Pourquoi commencer un article sur l’EEAT par cette histoire ? Parce que comprendre ce que Google dit officiellement sur l’évaluation de la qualité et ce qu’il fait réellement dans ses systèmes internes, c’est précisément là que se joue la différence entre une stratégie E.E.A.T SEO superficielle et une approche qui produit de vrais résultats durables. La quasi-totalité des guides disponibles sur le sujet se contentent de répéter les mêmes quatre définitions, les mêmes checklists basiques. Cet article prend un autre chemin.

En mai 2024, Google s’est trahi lui-même — et personne n’en a vraiment tiré les leçons

La fuite du Content Warehouse API de Google, révélée publiquement le 27 mai 2024 par Rand Fishkin (SparkToro) et analysée en profondeur par Mike King (iPullRank), est l’un des événements les plus importants de l’histoire du SEO. Pourtant, dans la plupart des articles francophones sur l’EEAT, cette fuite n’est pas mentionnée. C’est une omission qui coûte cher à ceux qui cherchent à comprendre réellement comment Google juge leur expertise.

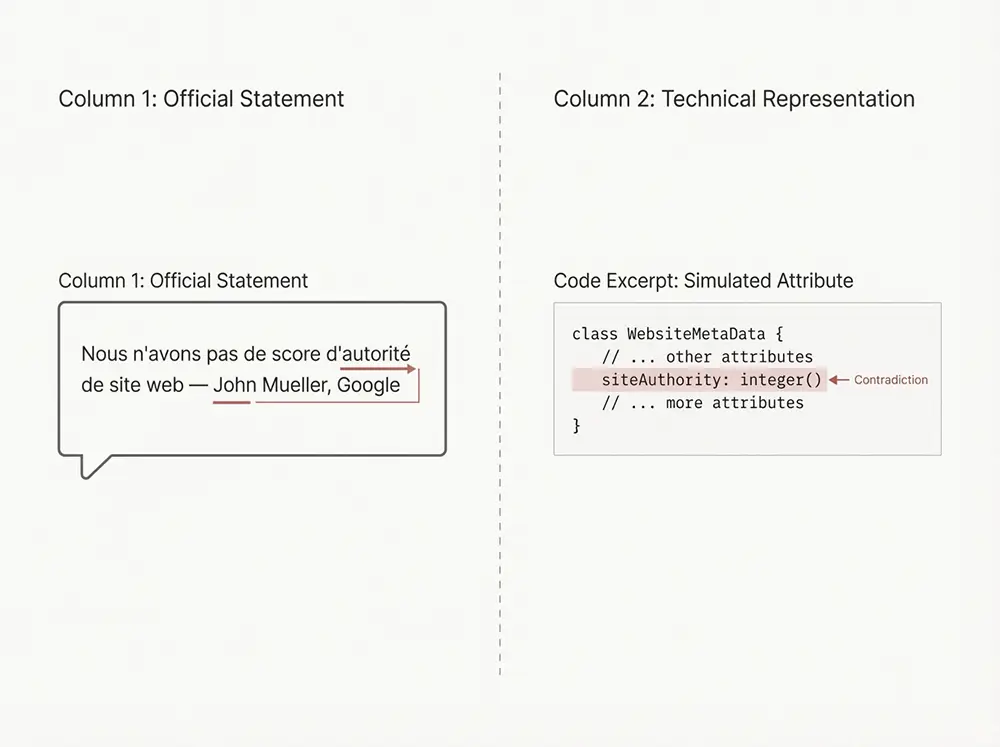

14 014 attributs, un « siteAuthority » qui n’existe pas… selon Google

Pendant des années, des représentants officiels de Google — dont Gary Ilyes et John Mueller — ont répété sur scène, en interview et sur les réseaux sociaux qu’il n’existait pas de score d’autorité de domaine dans leurs systèmes. John Mueller a déclaré explicitement : « we don’t have website authority score. » La documentation interne révélée en 2024 contient un attribut nommé siteAuthority, décrit comme un signal appliqué dans le système de classement Q* (QStar). Google stocke bel et bien une mesure d’autorité globale par site. Le débat est clos.

Cette révélation a une implication directe sur la façon dont vous devez envisager votre stratégie EEAT. Il ne s’agit pas seulement de prouver votre expertise page par page, article par article. La réputation et l’autorité s’accumulent au niveau du domaine entier. Un site perçu comme faiblement crédible dans son ensemble — même s’il publie un article excellent — partira avec un handicap structurel.

NavBoost, Chrome, sandbox : trois mensonges officiels que la fuite a définitivement enterrés

La fuite confirme également l’existence du système NavBoost, un mécanisme de reclassement basé sur les signaux de clics des utilisateurs : bons clics, mauvais clics, « last longest clicks » (le clic avec le plus long temps de session). Gary Ilyes avait qualifié ces théories de « made up crap » — pourtant, NavBoost est mentionné 84 fois dans la documentation interne, avec cinq modules portant ce nom dans leur titre. La documentation révèle aussi que Google utilise des données de navigation Chrome pour évaluer la qualité des pages, et qu’un attribut nommé hostAge est utilisé pour « sandboxer le spam frais » — confirmant l’existence d’un sandbox temporel nié pendant des années.

Ce que cela signifie concrètement pour votre stratégie de référencement naturel et d’expertise : le comportement réel des utilisateurs sur vos pages compte davantage que vous ne le pensez. Un contenu techniquement optimisé mais que les utilisateurs quittent rapidement envoie un mauvais signal. À l’inverse, un contenu qui génère des clics profonds et des sessions longues renforce votre siteAuthority réelle aux yeux de Google. L’EEAT n’est donc pas seulement une question d’étiquettes éditoriales — c’est une question d’engagement mesurable.

Ce que l’EEAT est vraiment — et ce qu’il n’est surtout pas

Avant d’aller plus loin, il convient de rectifier une confusion qui pollue une grande partie des contenus disponibles sur le sujet. L’EEAT n’est pas un facteur de classement direct. Google le dit lui-même dans sa documentation officielle : « While E-E-A-T itself isn’t a specific ranking factor, using a mix of factors that can identify content with good E-E-A-T is useful. » En d’autres termes, Google ne calcule pas un « score EEAT » qu’il injecterait dans son algorithme. Il utilise en revanche une multitude de signaux mesurables — dont certains, comme on vient de le voir, ont été soigneusement dissimulés pendant des années — pour approximer ce cadre de qualité éditorial.

Voici la distinction qui change tout : vous ne pouvez pas « cocher les cases » de l’EEAT et espérer une récompense algorithmique directe. Ce que vous pouvez faire, c’est construire des signaux réels d’expertise, d’autorité et de confiance qui, eux, nourrissent les vrais leviers de classement : autorité de domaine (siteAuthority), engagement utilisateur (NavBoost), profil de liens entrants, reconnaissance comme entité nommée dans le Knowledge Graph de Google.

Un cadre humain, pas un algorithme : les 16 000 Quality Raters que Google ne met pas assez en avant

L’EEAT est avant tout le référentiel utilisé par environ 16 000 évaluateurs humains — les Search Quality Raters — que Google emploie via des prestataires dans le monde entier. Ces personnes ne modifient pas directement les classements. Leur rôle est de noter la qualité des résultats produits par les algorithmes, permettant ainsi à Google de valider ou corriger ses systèmes de classement automatiques. Les critères qu’ils utilisent sont détaillés dans un document officiel de 181 pages, les Search Quality Rater Guidelines, dont la dernière mise à jour majeure date de janvier 2025.

Concrètement, si les Quality Raters notent systématiquement les résultats d’une requête donnée comme étant de faible qualité EEAT, Google utilisera ces retours pour entraîner ses systèmes à mieux identifier — et déclasser — les contenus similaires à l’avenir. C’est pourquoi aligner son contenu sur les critères de qualité éditoriale du cadre EEAT, c’est, par extension, s’aligner sur les idéaux que Google cherche à faire reproduire par ses algorithmes automatiques.

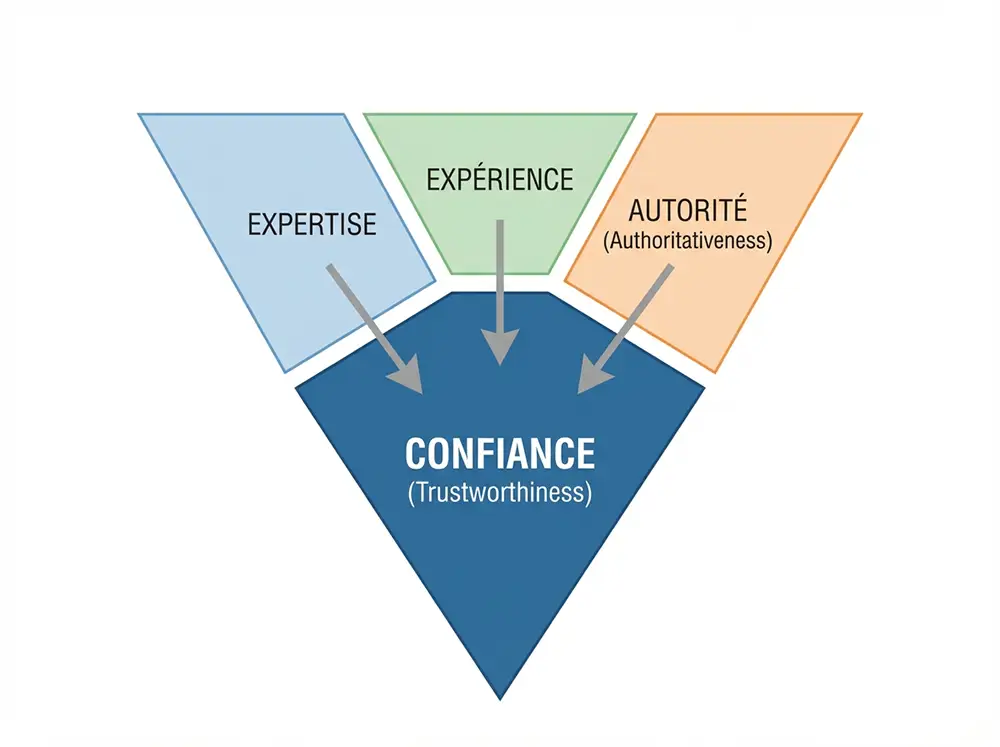

Les 4 piliers dans l’ordre qui compte vraiment (indice : ce n’est pas l’expérience)

Les quatre dimensions du cadre E.E.A.T SEO sont souvent présentées dans l’ordre de l’acronyme, comme si elles étaient équivalentes. Ce n’est pas ce que dit Google. La documentation officielle est explicite : « Trust is the most important member of the E-E-A-T family. » La confiance (Trustworthiness) est au centre. Les trois autres dimensions — expérience, expertise, autorité — contribuent toutes à la construire, mais aucune ne la remplace.

Voici comment hiérarchiser ces signaux de confiance SEO dans la pratique :

- Trustworthiness (confiance) : exactitude factuelle, transparence de l’auteur et de l’organisation, sécurité du site (HTTPS), politique de confidentialité, mentions légales complètes, absence d’informations trompeuses. C’est le prérequis absolu.

- Authoritativeness (autorité) : reconnaissance externe par des sources tierces fiables — backlinks de qualité issus de sites reconnus, mentions dans des médias spécialisés, citations dans des études ou rapports institutionnels.

- Expertise : connaissances démontrables sur le sujet traité, credentials vérifiables, profondeur analytique du contenu, vocabulaire précis et maîtrisé.

- Experience (expérience) : preuve d’un vécu direct — photos originales, études de cas réelles, données issues d’une pratique concrète, non d’une compilation de sources secondaires.

YMYL oui, mais l’EEAT s’applique aussi à votre blog de cuisine et votre site e-commerce

Une idée reçue très répandue consiste à réserver l’optimisation EEAT aux domaines dits YMYL (Your Money or Your Life) : santé, finance, droit, sécurité. Ces secteurs sont effectivement soumis à des standards d’évaluation de la crédibilité du contenu particulièrement élevés, car une information erronée peut avoir des conséquences directes sur la vie des utilisateurs. Pourtant, les guidelines de janvier 2025 s’appliquent à l’intégralité des requêtes, avec une intensité proportionnelle aux enjeux. Un article culinaire qui présente de fausses informations nutritionnelles, un guide e-commerce qui exagère les caractéristiques d’un produit, ou un blog voyage qui invente des avis sur des hôtels : tous sont évalués par ce même cadre, même si le niveau d’exigence est différent.

Comment Google « lit » votre expertise sans jamais vous demander votre CV

C’est ici que réside la vraie complexité du sujet — et là où la plupart des guides s’arrêtent trop tôt. Google ne vous demande pas votre diplôme. Il infère votre expertise à partir d’un ensemble de signaux distribués, dont une partie est entièrement hors de votre contrôle direct.

Les entités nommées et le Knowledge Graph : être une « personne réelle » pour un algorithme

Le Knowledge Graph de Google est une base de données massive d’entités nommées — personnes, organisations, lieux, concepts — et de leurs relations. Lorsqu’un auteur ou une marque est reconnu comme une entité dans ce graphe (via des données structurées schema.org, des mentions cohérentes sur le web, une présence Wikipédia ou Wikidata), Google peut associer les contenus publiés à cette entité et lui attribuer des signaux d’autorité agrégés. Être une « entité nommée » (Named Entity) pour Google, c’est exister de façon vérifiable et cohérente à travers des sources multiples et indépendantes.

La fuite de 2024 confirme que Google dispose d’un module spécifique lié aux auteurs comme attribut explicite des signaux de qualité documentaire. En d’autres termes, l’auteur n’est pas un champ de métadonnées facultatif : c’est un signal de classement réel, à condition qu’il corresponde à une entité identifiable et crédible dans les systèmes de Google. Une page auteur générée de toutes pièces, sans présence externe vérifiable, ne produit aucun signal EEAT réel — c’est ce qu’on appelle le « faux EEAT ».

Les signaux externes que vous ne contrôlez pas — et pourtant les plus décisifs

L’autorité perçue par Google ne se construit pas sur votre site. Elle se construit sur ce que les autres disent de vous. C’est pourquoi 83 % des sources citées dans les AI Overviews de Google présentent de forts signaux EEAT externes, selon une analyse publiée par Search Engine Journal en mai 2025. Les backlinks restent un signal majeur d’authoritativeness — mais leur qualité thématique et la réputation du domaine référent importent plus que leur volume brut. Une mention dans un article de référence de votre secteur vaut infiniment plus que dix liens de sites génériques.

À cela s’ajoutent les mentions de marque sans lien (brand mentions), les discussions sur des forums spécialisés, les citations dans des études, les participations à des événements professionnels relayées en ligne. Ces signaux diffus construisent ce que Google appelle en interne la réputation, distincte du PageRank. La différence est fondamentale : vous ne pouvez pas « acheter » votre réputation EEAT comme vous pouvez acheter des liens.

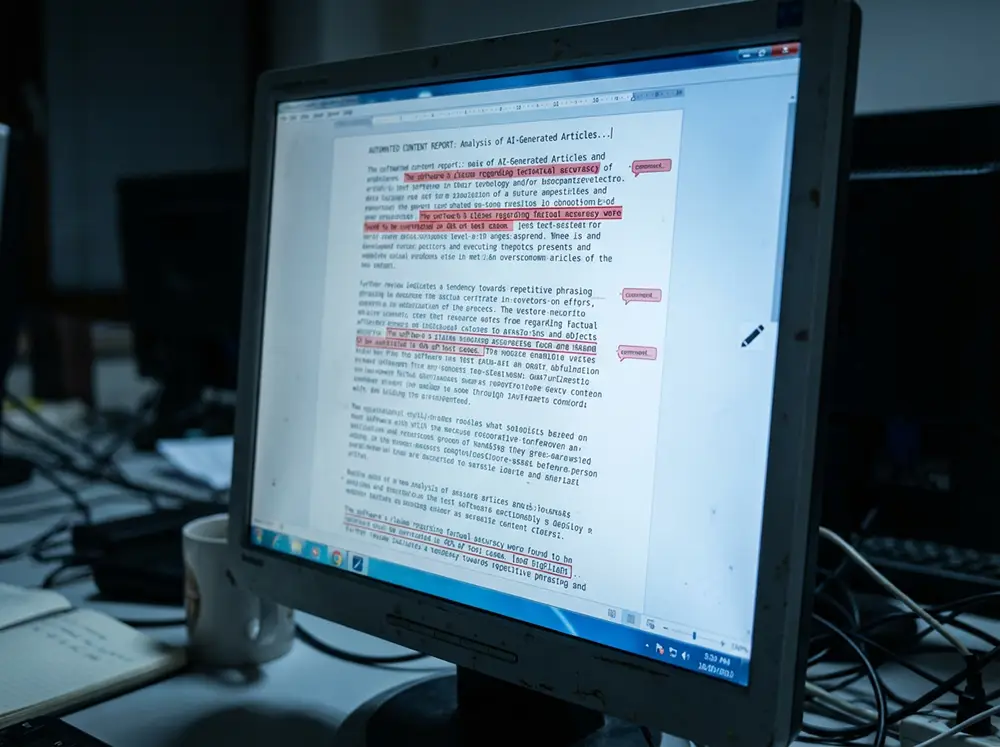

Contenu IA vs contenu humain : ce que les guidelines de janvier 2025 disent vraiment

La mise à jour des Search Quality Rater Guidelines de janvier 2025 a introduit une définition formelle de l’IA générative et des instructions précises pour évaluer le contenu généré automatiquement. La position de Google est nuancée — et souvent mal résumée. Google n’interdit pas le contenu produit par IA. Il sanctionne le contenu de faible qualité, qu’il soit généré par une machine ou par un humain paresseux. Les guidelines identifient trois catégories problématiques :

- Le filler content : contenu de remplissage qui retarde l’accès à l’information principale (phénomène particulièrement visible sur les sites de recettes ou les articles optimisés pour le volume).

- Le scaled content abuse : production massive de contenus paraphrasés, notamment via IA, sans valeur ajoutée originale. Le mot « paraphrasé » apparaît 25 fois dans la version de janvier 2025, contre 3 fois dans la précédente.

- Le low effort AI content : contenu généré par IA sans révision experte, sans données originales, sans angle distinctif — classé catégorie « Lowest Quality ».

En revanche, la combinaison IA + expertise humaine reste tout à fait acceptable. Un contenu dont la structure est assistée par IA mais enrichi de données terrain originales, relu par un expert du domaine et signé par un auteur identifiable respecte les normes éditoriales du cadre EEAT. Ce n’est pas l’outil qui détermine la qualité — c’est la valeur informationnelle produite.

Pour mieux comprendre ce mécanisme d’évaluation en pratique, la vidéo suivante de la chaîne Abondance décrypte les critères E.E.A.T de Google avec des exemples concrets :

Le faux EEAT : l’erreur que la majorité des sites commettent sans le savoir

Les mises à jour de mai 2025 des guidelines ont spécifiquement renforcé la détection de ce que les Quality Raters appellent le fake EEAT. C’est l’une des zones les plus dangereuses — et les moins documentées — de toute la littérature SEO francophone sur le sujet.

Biographies fictives, certifications invérifiables, avis fabriqués — et comment Google le détecte

Le faux EEAT désigne une pratique qui consiste à afficher les signaux d’expertise sans les posséder réellement. Les cas les plus fréquents sont les suivants : des pages auteur avec des photos de stock et des biographies génériques sans trace externe de la personne concernée ; des certifications ou diplômes mentionnés sur un site mais introuvables dans aucune base de données publique ou professionnelle ; des avis clients élogieux fabriqués ou achetés ; du contenu copié-reformulé présenté comme une analyse originale.

Comment Google détecte-t-il ces pratiques ? En croisant les signaux internes (contenu de la page auteur, données structurées) avec les signaux externes (présence de cet auteur sur d’autres sources crédibles, mentions sur LinkedIn, Wikidata, publications dans des médias tiers).

Un auteur dont la biographie revendique quinze ans d’expertise en cybersécurité mais qui ne possède aucune trace professionnelle publique vérifiable est un signal d’alerte fort. La cohérence entre l’identité revendiquée et l’identité observable dans l’écosystème web est au cœur de l’évaluation.

Un site ayant reçu une notation « Lowest » par les Quality Raters pour ce type de pratique peut voir sa visibilité se dégrader de façon persistante — les effets d’une Core Update touchant des sites à faible EEAT peuvent durer plusieurs mois, voire jusqu’à la Core Update suivante.

Le paradoxe du petit site expert face au média généraliste bien financé

C’est l’une des critiques légitimes que l’on peut adresser au cadre EEAT dans sa mise en œuvre algorithmique actuelle. Un expert reconnu dans son domaine, publiant sur un site récent avec peu de backlinks, se retrouve souvent déclassé face à un grand média généraliste qui traite le même sujet superficiellement, mais dont le siteAuthority — accumulé sur des années — absorbe les déficits de profondeur. 76 % des sites affectés par des Core Updates majeures présentaient de faibles signaux EEAT, selon des données relayées par Search Engine Journal. Pourtant, parmi eux se trouvent indéniablement des sources légitimes victimes d’un biais systémique en faveur des marques établies.

Ce paradoxe a une implication stratégique claire : pour un site jeune ou de niche, la démonstration d’expertise doit être particulièrement explicite, documentée et ancrée dans des preuves externes. Ce n’est pas injuste — c’est simplement le reflet d’un système qui ne peut pas encore lire directement le savoir. Il lit les signaux du savoir. Et les signaux s’accumulent.

EEAT selon votre secteur : ce qui compte pour un cabinet d’avocat ne compte pas pour un créateur de contenu

Le tableau suivant illustre comment les priorités EEAT varient selon le profil et le secteur d’activité :

| Profil / Secteur | Signal EEAT prioritaire | Forme de preuve recommandée | Risque « faux EEAT » principal |

|---|---|---|---|

| Cabinet médical / juridique (YMYL) | Expertise + Trustworthiness | Diplômes vérifiables, numéros d’ordre professionnel, publications scientifiques | Contenu rédigé sans validation par un professionnel qualifié |

| E-commerce spécialisé | Experience + Authoritativeness | Tests produits documentés, avis vérifiés, comparatifs basés sur des données terrain | Fiches produits génériques copiées depuis les fournisseurs |

| Blog / média thématique | Expertise + Experience | Page auteur détaillée, données originales, angle distinctif non disponible ailleurs | Contenu IA non retravaillé, paraphrase de sources concurrentes |

| Agence / prestataire B2B | Authoritativeness + Trustworthiness | Études de cas chiffrées, mentions presse, certifications partenaires vérifiables | Témoignages clients non identifiables, résultats invérifiables |

| Créateur de contenu / influenceur | Experience | Vécu personnel documenté, photos originales, retours d’expérience concrets | Opinions présentées comme des faits, absence de sources |

Prouver son expertise à Google : le protocole en 4 niveaux

Plutôt qu’une checklist de plus, voici une approche stratifiée qui va du plus accessible au plus décisif — en partant des signaux que vous contrôlez entièrement vers ceux qui nécessitent de construire une présence dans l’écosystème externe.

Niveau 1 — La couche documentaire : ce que votre site dit de vous

C’est le niveau de base, nécessaire mais insuffisant seul. Il comprend une page « À propos » détaillée mentionnant les qualifications réelles et vérifiables de l’équipe éditoriale, une page auteur pour chaque contributeur avec un lien vers ses profils professionnels externes (LinkedIn, publications, etc.), des mentions légales complètes incluant les informations d’identification de l’entité responsable du site, un certificat HTTPS valide, et une politique de confidentialité conforme au RGPD. L’implémentation de données structurées schema.org de type Person, Organization et Article avec propriété author permet à Google de lire ces informations de façon machine-readable et de les associer à des entités connues.

Niveau 2 — La couche éditoriale : ce que vos contenus prouvent

Chaque article ou page doit démontrer activement l’expertise — pas seulement l’affirmer. Cela signifie citer des sources primaires vérifiables (études scientifiques, rapports institutionnels, données officielles) avec des liens sortants vers ces sources, intégrer des données originales ou des observations issues d’une expérience terrain directe, adopter un niveau de précision terminologique qui distingue le contenu expert du contenu généraliste, et mettre à jour régulièrement les contenus stratégiques pour maintenir leur pertinence factuelle. Les guidelines de janvier 2025 insistent particulièrement sur le fait que Google cherche des contenus qui apportent une information qu’il serait impossible d’obtenir ailleurs — ce que la documentation officielle appelle « original information, reporting, research, or analysis ».

Niveau 3 — La couche relationnelle : ce que le web dit de vous

C’est ici que se joue l’essentiel de l’authoritativeness. Obtenez des backlinks depuis des publications de référence dans votre secteur — non pas par des tactiques d’acquisition de liens à grande échelle, mais par la création de contenus suffisamment originaux et cités pour générer des mentions organiques. Participez à des événements professionnels reconnus et assurez-vous qu’ils génèrent des mentions en ligne. Rédigez des contributions dans des médias spécialisés. Soyez actif sur des plateformes académiques ou professionnelles si votre secteur s’y prête (ResearchGate, Google Scholar, Légifrance pour les juristes, etc.). Chaque mention externe cohérente renforce votre identité comme entité de confiance dans les systèmes de Google.

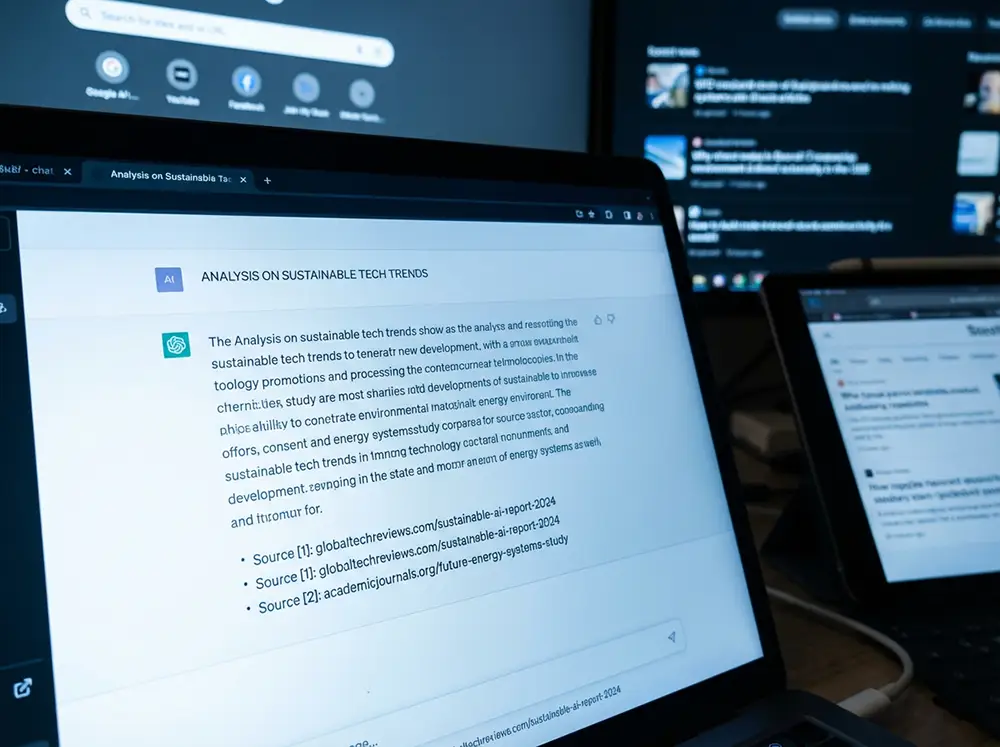

Niveau 4 — La couche GEO : ce que les IA diront de vous demain

L’émergence du GEO (Generative Engine Optimization) représente la prochaine frontière de l’EEAT. Avec 83 % des sources citées dans les AI Overviews de Google qui présentent de forts signaux EEAT, il est clair que le même cadre qui gouverne le référencement naturel classique devient également le passeport pour être cité par les moteurs de recherche génératifs — Google AI Overviews, ChatGPT, Perplexity. Les principes convergent : des données structurées correctement implémentées, une cohérence d’entité forte, des sources externes crédibles et une profondeur informationnelle inimitable par du contenu générique. La différence, c’est que dans les résultats génératifs, une seule source est souvent citée là où le SERP classique en affiche dix. L’enjeu de visibilité est donc encore plus concentré.

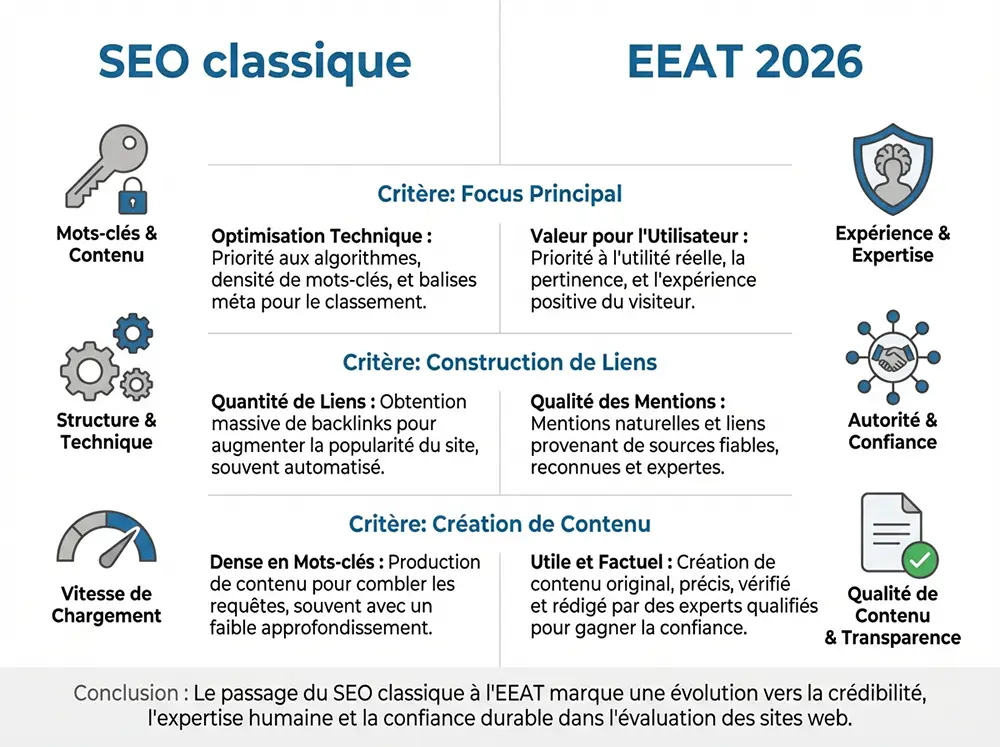

EEAT vs SEO classique : les priorités qui ont vraiment changé

Pour résumer l’évolution des priorités entre l’approche SEO traditionnelle et l’approche centrée sur le cadre de qualité éditorial EEAT, voici une comparaison directe :

| Critère SEO classique | Évolution sous le prisme EEAT | Niveau d’impact réel |

|---|---|---|

| Densité de mots-clés | Précision terminologique et champ sémantique expert | Élevé |

| Volume de backlinks | Qualité thématique et réputation des domaines référents | Très élevé |

| Longueur de contenu | Profondeur informationnelle et originalité des données | Élevé |

| Balise auteur (meta) | Entité auteur vérifiable, bio externe, cohérence identitaire | Moyen à élevé |

| Fréquence de publication | Exactitude factuelle et mises à jour substantielles | Élevé |

| Optimisation technique (CWV) | Prérequis maintenu, mais plus suffisant seul | Moyen (fondation) |

| Temps de session / CTR | Signal indirect via NavBoost (confirmé par la fuite 2024) | Élevé (sous-estimé) |

La leçon centrale de tout ce qui précède est la suivante. Vous ne pouvez pas optimiser l’EEAT comme vous optimisez une balise title. C’est un processus de construction de crédibilité réelle, mesurable dans l’écosystème web, qui nécessite entre six et douze mois pour produire des effets significatifs sur les classements — mais qui, une fois construit, constitue un avantage concurrentiel que personne ne peut copier en quelques semaines.

Questions fréquentes sur l’EEAT et le SEO

Pourquoi mon site perd-il du trafic après une Core Update malgré un contenu de qualité ?

Une Core Update réévalue les signaux EEAT au niveau du domaine entier, pas seulement page par page. Même un contenu excellent peut être affecté si le site global présente de faibles signaux d’autorité externe, une transparence insuffisante sur ses auteurs, ou un historique de contenu de faible qualité non encore nettoyé.

Est-ce que l’EEAT est un facteur de classement direct dans l’algorithme de Google ?

Non. Google le précise lui-même : l’EEAT n’est pas un facteur de classement direct. C’est un cadre d’évaluation qualitative utilisé par les Quality Raters humains pour entraîner les algorithmes automatiques. En revanche, les signaux qui composent l’EEAT — autorité de domaine, engagement utilisateur, profil de liens — sont bien des variables algorithmiques réelles.

Quelle est la différence entre EAT et EEAT dans les guidelines de Google ?

En décembre 2022, Google a ajouté un premier « E » pour « Experience » (Expérience) au cadre EAT (Expertise, Autorité, Fiabilité) existant depuis 2014. Cette addition reconnaît formellement que le vécu pratique et direct — distinct de l’expertise théorique — constitue une forme de crédibilité à part entière, particulièrement pour les contenus de type avis, tests ou retours d’expérience.

Est-il vrai que le contenu généré par IA détruit automatiquement l’EEAT d’un site ?

Non. Les guidelines de janvier 2025 distinguent clairement l’IA utilisée comme outil (acceptable) de l’IA utilisée pour produire massivement du contenu paraphrasé sans valeur ajoutée (sanctionnable). Un contenu IA enrichi d’expertise humaine, de données originales et signé par un auteur identifiable peut tout à fait respecter les standards EEAT.

Comment être cité par ChatGPT ou les AI Overviews de Google grâce à l’EEAT ?

Les moteurs génératifs citent prioritairement les sources qui présentent de forts signaux EEAT externes : autorité de domaine élevée, données structurées correctement implémentées, cohérence d’entité dans l’écosystème web. C’est le même socle que le SEO classique, mais avec une prime supplémentaire accordée à l’unicité informationnelle et à la précision factuelle vérifiable.

Combien de temps faut-il pour voir des résultats après avoir optimisé son EEAT ?

Les premiers signaux positifs apparaissent généralement entre un et trois mois (amélioration de l’engagement, premiers backlinks organiques). Des progressions visibles en classement nécessitent trois à six mois. Une position d’autorité établie dans une niche demande douze mois minimum — et s’entretient sur la durée.